¿Qué pasa cuando los datos son inexactos, desactualizados o incompletos?

En otras palabras, ¿qué pasa cuando Big Data se convierte en Bad Data?

#BadData quiere recoger historias personales sobre las consecuencias sociales, éticas o económicas de los datos mal utilizados.

Envíanos tu experiencia #BadData

Gracias a la inteligencia artificial, los algoritmos pueden ser entrenados por los datos y aprender de ellos. Pero lo que hace un algoritmo depende en gran medida de la calidad de los datos. Los datos pueden estar corruptos, desactualizados, inútiles o ilegales. De esta forma, los datos incorrectos juegan un papel importante en todo tipo de procesos y resultados de toma de decisiones.

#BadData

Desde la banca hasta la salud, los servicios sociales o la educación, los datos incorrectos pueden tener un impacto importante en nuestros derechos más fundamentales. En la parte inferior de esta página, encontrarás una lista de lectura llena de ejemplos concretos de cómo los datos incorrectos ya están afectando a la sociedad.

Frente a la competencia de la Pepsi Cola, de sabor más dulce, a mediados de la década de 1980, Coca-Cola probó una nueva fórmula en 200.000 sujetos.

Al igual que en el caso de los pagos por discapacidad en el Reino Unido, en los Estados Unidos ha habido varios casos en los que se realizaron reajustes radicales en la atención domiciliaria recibida por personas con una amplia gama de enfermedades y discapacidades, después de que se introdujo la evaluación algorítmica.

A partir de 2016, el número de apelaciones contra las decisiones tomadas por el Departamento de Trabajo y Pensiones sobre la base de las evaluaciones realizadas por los contratistas privados con fines de lucro que trabajan en su nombre comenzó a aumentar drásticamente.

Cambridge Analytica, una empresa privada, pudo recopilar 50 millones de perfiles de Facebook y utilizarlos para crear un potente programa de software para predecir e influenciar en las elecciones electorales.

Deloitte Analytics llevó a cabo una encuesta en la que se comprobó la precisión de los datos comerciales utilizados para marketing, investigación y gestión de productos.

En el año 2000, comenzó un problema con el agua potable de Washington D.C. cuando los funcionarios cambiaron el desinfectante que usaban para purificar el agua. Se suponía que el interruptor haría que el agua fuera más limpia. Pero el cambio también aumentó la corrosión de las tuberías de plomo de la ciudad, aumentando la cantidad de plomo en el agua.

La policía utiliza cada vez más software predictivo. Esto es particularmente desafiante porque en realidad es bastante difícil identificar sesgos en los modelos de predicción de la justicia penal. Esto se debe en parte a que los datos policiales no se recopilan de manera uniforme, y en parte a que los datos que la policía rastrea reflejan sesgos institucionales existentes desde hace mucho tiempo a lo largo de las líneas de ingresos, raza y género.

Lanzado en el 2008 con la esperanza de utilizar información sobre las búsquedas en línea de las personas para detectar brotes de enfermedades, Flu Trend de Google monitorearía las búsquedas de los usuarios e identificaría lugares donde muchas personas estaban investigando varios síntomas de la gripe. En esos lugares, el programa alertaría a las autoridades de salud pública que más personas estaban a punto de contagiarse de gripe.

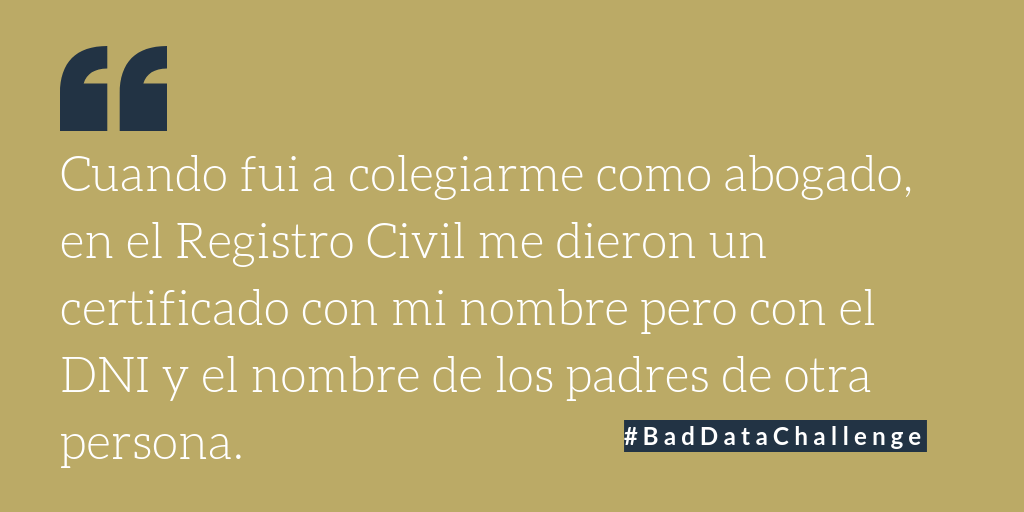

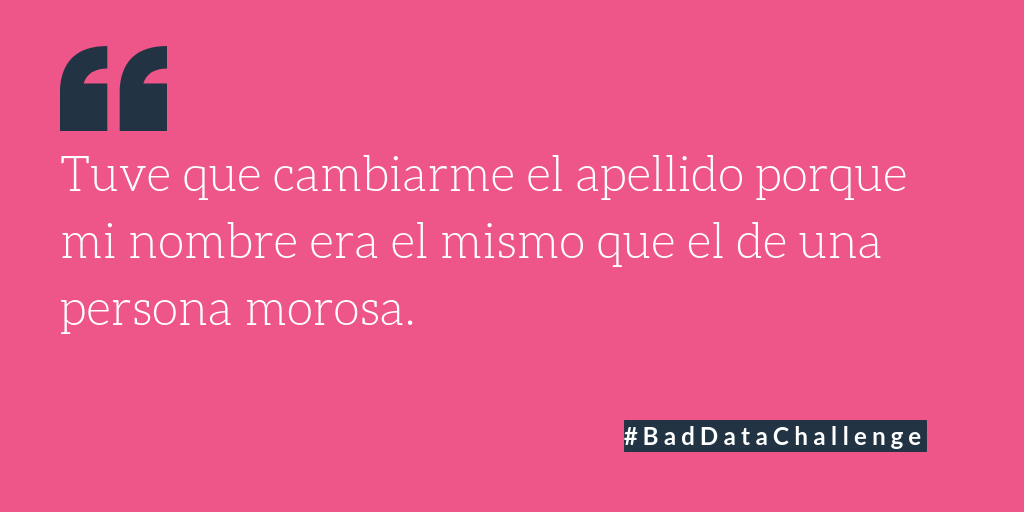

En 2018 Eticas inició un #BadDataChallenge y los resultados fueron abrumadores porque, con solo preguntarse, las personas se dieron cuenta de que al menos una vez en su vida se enfrentaron al BadData. Algunos terminaron pagando el seguro médico de otra persona, otros tenían los nombres de sus padres equivocados en su DNI, lo que complicaba su proceso de identificación constantemente..

A menos que se indique lo contrario, el contenido de este sitio está bajo una licencia de Creative Commons Reconocimiento 4.0 Internacional.

Facing competition from the sweeter-tasting Pepsi Cola in the mid-1980s, Coca-Cola tested a new formula on 200,000 subjects. It beat Pepsi and the classic formula time after time in a series of taste tests. Yet the market research focused entirely on taste, ignoring several other factors that motivate people to purchase Coca Cola. Because marketers didn’t consider the classic formula’s relation to the larger brand, the company lost tens of millions of dollars and had to pull New Coke from the shelves.

Source:

https://www.utopiainc.com/resources/blog/how-bad-data-changed-the-course-of-history

Al igual que en el caso de los pagos por discapacidad en el Reino Unido, en los Estados Unidos ha habido varios casos en los que se realizaron reajustes radicales en la atención domiciliaria recibida por personas con una amplia gama de enfermedades y discapacidades, después de que se introdujo la evaluación algorítmica.

While most reporting on this has focused on the algorithms and their codes, important problems with the assessments were also found. Kevin De Liban, an attorney for Legal Aid of Arkansas, started keeping a list of these. One variable in the assessment was foot problems. When an assessor visited a certain person, they wrote that the person didn’t have any problems — because they were an amputee. Over time, De Liban says, they discovered wildly different scores when the same people were assessed, despite being in the same condition.

Source:

https://www.theverge.com/2018/3/21/17144260/healthcare-medicaid-algorithm-arkansas-cerebral-palsy

Starting in 2016, the number of appeals against decisions made by the Department of Work and Pensions on the basis of assessments made by the private, profit driven contractors working on its behalf began to increase dramatically. There were 60,600 Social Security & Child Support appeals between October and December 2016, a 47% increase. Roughly 85% of those appeals were accounted for by the Personal Independence Payment (PIP) and the Employment & Support Allowance (ESA).

It was not just the number of appeals that increased rapidly, either. The rate at which decisions made by the DWP also rose substantially to almost two-thirds of all appeals. Clearly, there was a problem with the assessment process. On the one hand, the weighting of different criteria for eligibility in the Personal Independence Payments program was changed. On the other hand, the people hired by private firms to carry out PIP assessments apparently altered data, with clearly discriminatory effects. As a result, the DWP spent millions on appeals, and a total of 1.6 million disability benefit claims will be reviewed.

http://www.bbc.com/news/health-41581060

http://www.bbc.com/news/uk-politics-35861447

Cambridge Analytica, a private company, was able to harvest 50 million Facebook profiles and use them to build a powerful software program to predict and influence election choices. Data was collected thanks to an application: users were paid to take a personality test and agreed to have their data collected for academic use. However, this data, and that of their friends, were then used to build the software, thus violating Facebook’s “platform policy”, which allows collection of data to improve user experience in the app and barred it being sold on or used for advertising. Even though the responsibility of each side are not yet totally clear, this case shows the illicit use of personal data as consequence of poor and unlawful practices/policies in the collection and elimination of data.

Deloitte Analytics conducted a survey testing how accurate commercial data used for marketing, research and product management is likely to be. They found that:

Source:

https://www2.deloitte.com/insights/us/en/deloitte-review/issue-21/analytics-bad-data-quality.html

La policía utiliza cada vez más software predictivo. Esto es particularmente desafiante porque en realidad es bastante difícil identificar sesgos en los modelos de predicción de la justicia penal. Esto se debe en parte a que los datos policiales no se recopilan de manera uniforme, y en parte a que los datos que la policía rastrea reflejan sesgos institucionales existentes desde hace mucho tiempo a lo largo de las líneas de ingresos, raza y género.

While police data are often described as representing “crime,” that’s not quite accurate. Crime itself is a largely hidden social phenomenon that happens anywhere a person violates a law. What are called “crime data” usually tabulate specific events that aren’t necessarily lawbreaking—like a 911 call—or that are influenced by existing police priorities, like arrests of people suspected of particular types of crime, or reports of incidents seen when patrolling a particular neighborhood.

Neighborhoods with lots of police calls aren’t necessarily the same places the most crime is happening. They are, rather, where the most police attention is. And where that attention focuses can often be biased by gender and racial factors.

A recent study by the Human Rights Data Analysis Group found that predictive policing vendor PredPol’s purportedly race-neutral algorithm targeted black neighborhoods at roughly twice the rate of white neighborhoods when trained on historical drug crime data from Oakland, California. Similar results were found when analyzing the data by income group, with low-income communities targeted at disproportionately higher rates compared to high-income neighborhoods. This was despite the fact that estimates from public health surveys and population models suggest that illicit drug use in Oakland is roughly equal across racial and income groups. If the algorithm were truly race-neutral, it would spread drug-fighting police attention evenly across the city.

Similar evidence of racial bias was found by ProPublica’s investigative reporters when they looked at COMPAS, an algorithm predicting a person’s risk of committing a crime, used in bail and sentencing decisions in Broward County, Florida, and elsewhere around the country. These systems learn only what they are presented with; if those data are biased, their learning can’t help but be biased too.

Source:

https://www.fastcompany.com/40419894/how-big-bad-data-could-make-policing-worse

Lanzado en el 2008 con la esperanza de utilizar información sobre las búsquedas en línea de las personas para detectar brotes de enfermedades, Flu Trend de Google monitorearía las búsquedas de los usuarios e identificaría lugares donde muchas personas estaban investigando varios síntomas de la gripe. En esos lugares, el programa alertaría a las autoridades de salud pública que más personas estaban a punto de contagiarse de gripe.

But the project failed to account for the potential for periodic changes in Google’s own search algorithm. In an early 2012 update, Google modified its search tool to suggest a diagnosis when users searched for terms like “cough” or “fever.” On its own, this change increased the number of searches for flu-related terms. But Google Flu Trends interpreted the data as predicting a flu outbreak twice as big as federal public health officials expected, and far larger than what actually happened. This is a good case of bad data because it involves information biased by factors other than what was being measured.

Sources:

https://www.fastcompany.com/40419894/how-big-bad-data-could-make-policing-worse