Nuestros proyectos

VioGén es un algoritmo que determina el nivel de riesgo de una víctima de violencia de género y establece sus medidas de protección en España. Es el mayor sistema de valoración del riesgo del mundo, con más de 3 millones de casos registrados. Desde 2018, Eticas se ha puesto en contacto con el Ministerio español en varias ocasiones y ha ofrecido una auditoría interna confidencial pro-bono del sistema VioGén. Aunque esta sugerencia fue bien recibida, no se tomó ninguna medida. En 2021, decidimos hacer una auditoría externa de este sistema de gran impacto social con la colaboración de

If data can be bad, can decisions based on data be good? This project seeks to de-mystify some of the common assumptions about how data works, showing that bad, BadData can have real-life consequences” sometimes trivial, others life-changing and inescapable.

Las reforzadas medidas de seguridad han convertido los aeropuertos en densos ecosistemas de datos y la movilidad humana en un proceso de vigilancia continua. La digitalización de los viajes y el cruce de fronteras está teniendo impactos que van más allá de lo meramente práctico. ¿Podrían los datos estar cambiando la naturaleza de las fronteras, nuestra relación con nuestros cuerpos biométricos y nuestra definición de identidad y pertenencia?

¿Cómo se utilizan los datos personales en las escuelas? Durante 2017 y 2018 investigamos cómo el monitoreo del aprendizaje está impactando en la docencia y en la privacidad, mediante la observación de cómo las tecnologías de vigilancia están proliferando en la educación: desde cámaras CCTV en los lavabos hasta la EdTech.

La digitalización, la automatización y la inteligencia artificial están reorganizando el mundo del trabajo y apuntando a un futuro donde puede ser diferente de lo que es hoy. En este entorno cambiante, desde 2019 nos hemos asociado con organizaciones sindicales para pensar colectivamente en estos desafíos y desarrollar una agenda tecnológica que incorpore privacidad, derechos laborales digitales y estándares éticos en las relaciones laborales. Para convertir nuestra investigación en práctica, hemos creado una caja de herramientas, en constante construcción, de recursos que los representantes sindicales pueden utilizar para expresar sus preocupaciones sobre el uso y el impacto de las tecnologías intensivas en datos en el trabajo.

Durante los últimos años (2018, 2020) nos hemos asociado con la Electronic Frontier Foundation en EE.UU. y otras organizaciones de América Latina para alentar a las compañías de Internet a estar del lado de sus usuarios en la defensa de su privacidad y en la promoción de sus derechos digitales. Hemos diseñado una serie de criterios de valoración que sirven como guía para evaluar y comparar cómo las empresas tratan los datos y protegen sus derechos, y en función de los resultados obtenidos, las clasificamos. Estos criterios de evaluación están diseñados para ir más allá de lo estrictamente estipulado por la ley, ya que buscamos promover las mejores prácticas en defensa de los derechos de privacidad de los usuarios y clientes.

Los datos están en todas partes. En la era digital, las huellas de nuestros datos incluyen información sobre lo que hacemos, a dónde vamos, a quién conocemos, qué tenemos, qué nos gusta o cómo nos sentimos. Generamos esta información mientras trabajamos, caminamos, interactuamos, hablamos, protestamos o navegamos en Internet. Las actividades en las que participamos generan datos a su vez, y toda esta información es útil para configurar servicios, productos y ciudades, así como para promover la transparencia y la responsabilidad. Nos asociamos con el Open Data Institute en el Reino Unido para desarrollar pautas prácticas que ayuden a las organizaciones a anonimizar los datos que usan, publican y comparten.

Las mujeres continúan siendo discriminadas en todas las áreas y campos, pero específicamente en las TIC. Este estudio es un diagnóstico de políticas de género en las TIC, donde analizamos el ecosistema de tecnologías de información y comunicación en Barcelona desde una perspectiva de género para descubrir las relaciones causales que dan lugar y perpetúan la brecha digital de género en la ciudad. Evaluamos y revisamos la situación y los datos actuales de diferentes sectores, desde el trabajo hasta la educación, pero también las asociaciones culturales y la administración pública, para ayudar a los responsables políticos a comprender dónde están las brechas y las oportunidades para abordar la discriminación de género.

Últimas entradas en el blog

Cómo proteger tu privacidad de las apps del día a día

Como revelamos en nuestro estudio ‘Mi cuerpo, mis datos, sus normas’ las apps de seguimiento menstrual, a pesar de su apariencia inocente, vulneran la privacidad de sus usuarios, pero hay muchas otras aplicaciones que utilizamos diariamente que saben más sobre nuestras vidas de lo que podríamos imaginar y, pueden estar

Cómo proteger tu privacidad de las apps del día a día

Como revelamos en nuestro estudio ‘Mi cuerpo, mis datos, sus normas’ las apps de seguimiento menstrual, a pesar de su apariencia inocente, vulneran la privacidad de sus usuarios, pero hay muchas otras aplicaciones que utilizamos diariamente que saben más sobre nuestras vidas de lo que podríamos imaginar y, pueden estar

Tips to understand how AI impacts young people

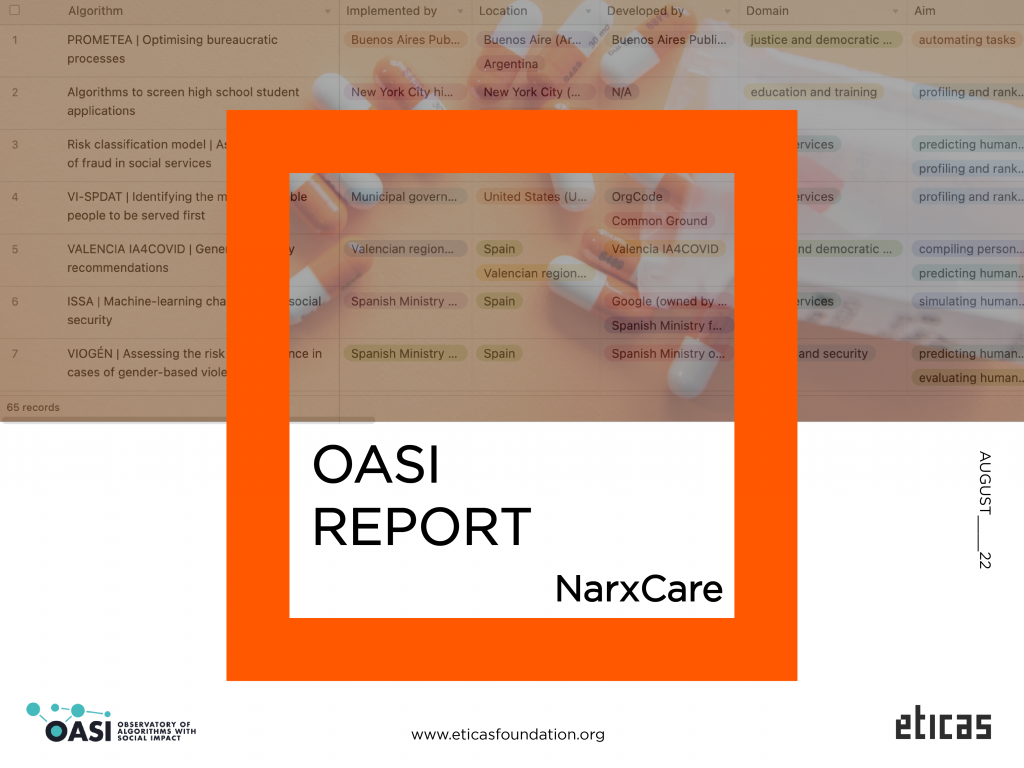

NarxCare, an algorithm to predict the risk of narcotic, sedative and stimulant abuse

The environmental cost of AI: a savior or a destroyer?

El impacto medioambiental de la IA: ¿salvadora o destructora?

Últimas entradas en el blog

Cómo proteger tu privacidad de las apps del día a día

Tips to understand how AI impacts young people

NarxCare, an algorithm to predict the risk of narcotic, sedative and stimulant abuse

The environmental cost of AI: a savior or a destroyer?

Suscríbete para recibir noticias

Apúntate a nuestra lista de correo y síguenos en Twitter.

Solo usaremos sus datos (su nombre y correo electrónico) para enviarle actualizaciones sobre nuestros últimos proyectos, publicaciones y eventos. Los datos solo se compartirán con MailChimp, nuestro proveedor de comunicaciones por correo electrónico y su política de privacidad está aquí. Mientras tengamos sus datos, los mantendremos seguros y protegidos. No dude en cancelar la suscripción en cualquier momento. Si cancela la suscripción, su correo electrónico se eliminará. Una vez dado de baja, la Fundación Eticas no utilizará su correo electrónico para ningún otro propósito. Si decidimos cancelar las actualizaciones, también eliminaremos sus datos.